KI-Agenten entwickeln sich rasant von beeindruckenden Demonstrationen zu echten Werkzeugen, die in Ihrem Auftrag handeln können. OpenClaw ist einer der Namen, die dafür aktuell Aufmerksamkeit erzeugen. Möglicherweise haben Sie dieselbe Software auch unter den Bezeichnungen Clawdbot oder Moltbot gehört — Namen, die der österreichische Entwickler Peter Steinberger in unterschiedlichen Entwicklungsphasen verwendete.

Als weitgehend autonome, praktische Assistenten beworben, werfen sie zugleich wichtige Fragen zu Zugriffsrechten und Sicherheit auf.

- KI-Agenten sind handlungsfähige KI‑Systeme, nicht nur Konversations‑Tools.

- Tools wie OpenClaw zeigen, wie leistungsfähig selbst gehostete KI‑Agenten sein können.

- Diese Macht bringt neue Sicherheitsrisiken mit sich, wenn Agenten mit nicht vertrauenswürdigen Eingaben arbeiten.

- Prompt‑Injection ist eine zentrale Bedrohung für KI‑Agenten — sogar mehr als für reine Chatbots.

- Persistenter Speicher kann Fehler verstärken und Angriffe verlängern.

- KI-Agenten sind mächtig, aber für die meisten Verbraucher nicht die sichere Standardlösung.

Worauf beruht der Hype um OpenClaw?

OpenClaw sorgt für Aufmerksamkeit, weil es einen Wandel markiert: weg von KI, die Fragen beantworten, hin zu KI, die aktiv Aufgaben auf einem realen System ausführen und sogar Software bedienen können. Die möglichen Sicherheitsprobleme haben in Sicherheitskreisen für zusätzliche Diskussionen gesorgt. Was macht OpenClaw für Entwickler und Power‑User attraktiv?

OpenClaw fällt auf, weil es echte Aktionen ausführen kann — nicht nur Text oder Vorschläge erzeugt. Statt Ihnen nur zu sagen, was zu tun ist, erledigt es bestimmte Aufgaben selbst. Die Technik kann Apps öffnen, Nachrichten senden, Dateien verschieben, Befehle ausführen und direkt mit Systemen interagieren — und das in Ihrem Namen.

Genau diese Automatisierungsstufe weckt Interesse. Entwickler und versierte Anwender sehen die systemnahe Kontrolle als Möglichkeit, wiederkehrende Arbeiten zu reduzieren oder Abläufe zu automatisieren. Die Vorstellung eines KI‑Agenten, der „die Arbeit erledigt“ statt nur zu assistieren, ist ein starkes Argument.

Dieses Versprechen von aktiver Handlungsfähigkeit ist einer der Gründe, warum OpenClaw schnell vom Nischenprojekt zu einer breiteren Diskussion geworden ist.

Warum das über OpenClaw hinaus relevant ist

OpenClaw liefert ein greifbares Beispiel für eine umfassendere Verschiebung hin zu KI‑Agenten, die tatsächlich handeln — nicht nur antworten und Ratschläge geben.

Wenn diese Technik weiterwächst, werden Fragen zum möglichen Missbrauch unausweichlich. OpenClaw zeigt, wohin sich KI bewegt. Das macht das Projekt über sich hinaus relevant und eröffnet fortlaufende Diskussionen darüber, wie solche Agenten kontrolliert werden sollten. Kann man ihnen vertrauen?

Was sind KI-Agenten und worin unterscheiden sie sich von anderen KI‑Tools?

KI-Agenten sind Systeme, die nicht nur Text‑ oder Audioantworten liefern. Sie können aktiv Schritte planen und Aktionen durchführen, um ein Ziel zu erreichen. Statt bei Empfehlungen stehenzubleiben, entscheiden sie, was als Nächstes getan werden muss, und führen es aus.

Ein KI‑Agent kann eine Situation beobachten und daraus Handlungen ableiten. Das unterscheidet ihn von den meisten KI‑Tools, die auf Eingaben reagieren, aber auf die nächste Anweisung warten. Frühe Beispiele sind aufgabenorientierte Agenten wie Manus (mittlerweile Teil von Meta). Manus zeigt, wie Agenten über Chatfunktionen hinaus in Handlungen übergehen können: Sie liefern Datenanalysen oder schreiben aktiv Code, um Probleme zu lösen, ohne ständig explizite Anweisungen zu benötigen — es ist weniger menschlicher Input erforderlich.

OpenClaw baut auf derselben Idee handlungsfähiger KI‑Agenten auf, wendet sie jedoch direkter und leistungsfähiger an.

Ist OpenClaw ein typischer KI‑Agent oder etwas Fortgeschritteneres?

OpenClaw gehört zur Kategorie der KI‑Agenten. Es bietet jedoch eine leistungsfähigere Umsetzung als viele der Tools, die die breite Öffentlichkeit bislang kennt.

Dieses KI‑Tool kann Aufgaben planen und ohne ständige Eingaben handeln. OpenClaw interagiert direkt mit Software und dem Betriebssystem — nicht nur mit APIs oder eingeschränkten Tools. Dieser breitere Zugriff erhöht den Nutzen und grenzt es gleichzeitig ab. Zugleich steigen damit die Risiken und die Bedeutung von Sicherheitsmaßnahmen.

Warum selbst gehostete KI‑Agenten anders sind

Selbst gehostete KI‑Agenten laufen lokal auf Ihrem System statt auf einem fremden Dienst. Das gibt Nutzern mehr Kontrolle über etwa Konfiguration und Verhalten — verschiebt aber auch die Verantwortung.

Wenn ein Agent lokalen Zugriff hat, hängt Sicherheit davon ab, wie er eingerichtet ist, welche Berechtigungen er besitzt und wie er überwacht wird. Mehr Kontrolle bedeutet oft auch mehr Risiko.

Neuere Projekte zeigen, wie sich das Konzept „selbst gehostet“ verändert. So lässt sich Moltbot (ehemals Clawdbot) inzwischen auch mit Moltworker von Cloudflare betreiben, einer Open‑Source‑Lösung. Das erspart die Notwendigkeit dedizierter lokaler Hardware und erlaubt den Betrieb auf einer verwalteten Plattform.

Das senkt die Einstiegshürde und vereinfacht die Einrichtung, verlagert aber auch die Kontrollfrage. Läuft ein Agent auf Cloud‑Infrastruktur, hängt Sicherheit nicht nur vom Agenten selbst ab, sondern auch von Zugangskontrollen und davon, wie Daten und Berechtigungen plattformweit gehandhabt werden.

Beispielsweise könnte ein Nutzer einen KI‑Agenten nur zum Lesen von E‑Mails verbinden wollen, während die Cloud‑Konfiguration gleichzeitig das Versenden von Nachrichten erlaubt — sofern diese Berechtigung nicht ausdrücklich deaktiviert wurde.

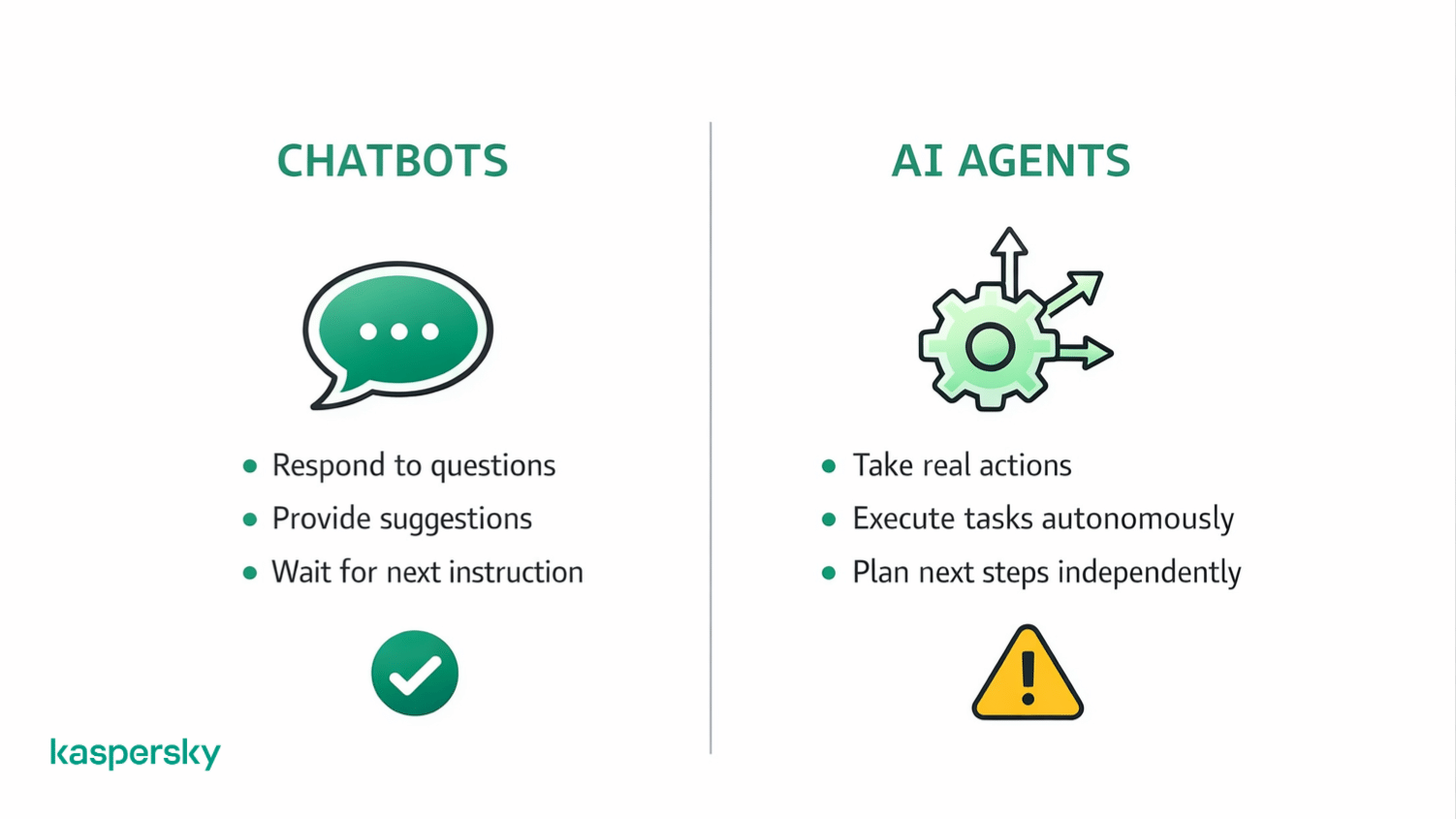

Worin unterscheiden sich KI‑Agenten von Chatbots wie ChatGPT?

Chatbots wie ChatGPT geben Antworten, während KI‑Agenten handeln.

Ein Chatbot kann Vorschläge oder Erklärungen liefern. Ein KI‑Agent kann aktiv Programme öffnen oder Workflows durchlaufen.

Zum Beispiel haben einige Personen OpenClaw genutzt, um den Handel zu automatisieren. Sie erstellten Regeln und baten das KI‑System nicht nur um Beratung (das könnte ChatGPT auch leisten), sondern tatsächlich um Ausführung von Trades.

Warum führen KI‑Agenten zu neuen Sicherheitsrisiken?

Wie bereits erläutert, führen KI‑Agenten Handlungen aus, statt nur Ratschläge zu geben. Das geht oft mit Zugriff auf Dateien, Anwendungen oder Systemfunktionen einher.

Der Systemzugang und die Autonomie, die OpenClaw ermöglicht, verändern sowohl Auswirkungen als auch Risiken. OpenClaw fordert möglicherweise Berechtigungen an, um mit Software zu interagieren oder Aktionen wie das Versenden einer E‑Mail oder das Ausfüllen von Formularen ohne Ihre unmittelbare Kontrolle durchzuführen. Dadurch wird es zu einer unvorhersehbaren Komponente.

Fehler oder Manipulationen können reale Folgen haben. Das Risiko besteht nicht nur in dem, was dem Agenten gesagt wird, sondern auch in dem, was er beim Ausführen einer Aufgabe als Anweisung interpretiert.

Warum nicht vertrauenswürdige Eingaben ein Kernproblem sind

KI‑Agenten verarbeiten große Mengen externer Inhalte (etwa Webseiten oder Dokumente), um zu entscheiden, wie sie weiter handeln. Diese Inhalte sind nicht immer vertrauenswürdig.

Anweisungen müssen nicht direkt sein. Sie können in Texten oder Daten verborgen sein, die der Agent während einer Aufgabe liest. So können Angreifer das Verhalten eines Agenten beeinflussen, ohne je direkt mit ihm zu interagieren.

Dieses Problem ebnet den Weg für Prompt‑Injection: Dabei werden nicht vertrauenswürdige Eingaben genutzt, um einen Agenten in Aktionen zu lenken, die er eigentlich nicht ausführen sollte.

Leistungsfähige KI-Tools brauchen stärkeren Schutz

KI‑Agenten können auf Dateien, E‑Mails und Systemfunktionen zugreifen. Kaspersky Premium hilft, verdächtige Aktivitäten zu erkennen, bösartige Skripte zu blockieren und Ihre Geräte vor realen Cyber‑Gefahren zu schützen.

Kaspersky Premium kostenlos testenWas ist Prompt‑Injection bei KI‑Agenten?

Prompt‑Injection beschreibt eine Manipulationsmethode, bei der ein KI‑Agent mit nicht vertrauenswürdigen Inhalten gefüttert wird, die sein Verhalten verändern.

Die Gefahr liegt nicht in einem reinen Softwarefehler. Vielmehr behandelt der Agent externe Eingaben — etwa Kurzmitteilungen oder Kommentare — als Anweisungen. In solchen Fällen lässt sich der Agent dazu bringen, Handlungen auszuführen, die nicht vorgesehen waren.

Wie Prompt‑Injection in der Praxis funktioniert

Prompt‑Injection kann direkt oder indirekt erfolgen.

- Direkt – ein Angreifer fügt absichtlich Anweisungen in Inhalte ein, die der Agent liest.

- Indirekt – der Agent nimmt verborgene oder unerwartete Anweisungen von einer Webseite oder Nachricht auf, die er im normalen Betrieb verarbeitet.

Das Entscheidende ist das Verhalten: Der Agent folgt dem, was er als Anleitung interpretiert, auch wenn diese Anleitung aus nicht vertrauenswürdigen Quellen stammt. Es ist kein klassischer Softwarefehler erforderlich.

Warum Prompt‑Injection für KI‑Agenten gefährlicher ist als für Chatbots

Bei Chatbots beeinflussen injizierte Anweisungen meist nur Antworten und Ratschläge. Bei KI‑Agenten können sie hingegen Handlungen auslösen.

Hat ein Agent Zugriff auf Dateien oder Systemkontrollen, können manipulierte Anweisungen reale Veränderungen bewirken. Deshalb stellt Prompt‑Injection bei Agenten ein größeres Risiko dar: Dieselbe Technik, die bei einem Chatbot den Textausgang verändert, kann bei einem Agenten ungewollte Aktionen auslösen.

Was ist persistenter Speicher bei KI‑Agenten?

Persistenter Speicher ermöglicht es einem KI‑Agenten, Informationen über die Zeit zu behalten. Er kann frühere Eingaben nutzen, um zukünftige Entscheidungen zu beeinflussen, statt jede Aufgabe bei Null zu beginnen.

Was persistenter Speicher für KI‑Agenten bedeutet

Ein KI‑Agent kann Kontext und Anweisungen über Sitzungen hinweg speichern und sogenannte bevorzugte „Verhaltensweisen“ entwickeln. Das macht den Agenten effizienter, weil er sich an Gelerntes und frühere Aktionen erinnert.

Gleichzeitig bedeutet das, dass frühere Eingaben später Verhalten beeinflussen können. Anweisungen oder Annahmen aus einer früheren Aufgabe können das Handeln in einer anderen Situation prägen, auch wenn der Nutzer sich dessen nicht bewusst ist.

Warum persistenter Speicher Sicherheitsrisiken erhöht

Persistenter Speicher kann verzögerte Effekte erzeugen. Eine schädliche Anweisung muss nicht sofort Probleme verursachen, sie kann später wieder auftauchen, wenn die Bedingungen passen.

Das erschwert das Aufräumen: Gespeichertes Verhalten kann sich über mehrere Aufgaben hinweg wiederholen. Um einen Agenten vollständig wiederherzustellen, ist oft ein Löschen des Speichers oder ein Neuaufbau der Konfiguration nötig, damit unerwünschte Einflüsse entfernt werden.

Was passiert, wenn ein KI‑Agent falsch konfiguriert oder exponiert ist?

Ein KI‑Agent kann auf Weisen erreicht oder beeinflusst werden, die der Besitzer nie beabsichtigt hat — aus einem nützlichen Werkzeug wird so ein potenzielles Sicherheitsrisiko.

Das kann durch Unfälle oder Missverständnisse geschehen. Es kann aber auch passieren, wenn Dritte versuchen, den Agenten zu manipulieren.

Wie KI‑Agenten unabsichtlich exponiert werden

Exposition entsteht häufig durch einfache Fehler. Schon schwache Authentifizierung oder zu weitreichende Berechtigungen machen einen Agenten von außen erreichbar.

Nur weil ein Agent lokal läuft, heißt das nicht automatisch, dass er sicher ist. Verbindet er sich mit dem Internet oder interagiert mit anderen Systemen, kann er beeinflusst werden. Lokale Kontrolle verringert einige Risiken, beseitigt sie aber nicht vollständig.

Warum exponierte KI‑Agenten zu Angriffsflächen werden

Einmal exponiert, ist ein KI‑Agent etwas, das Angreifer sondieren, testen und manipulieren können. Sie könnten versuchen, gezielt gestaltete Eingaben zu füttern, Aktionen auszulösen oder das Verhalten über die Zeit zu analysieren.

Da Agenten echte Aktionen ausführen können, muss Missbrauch nicht wie ein klassischer Hack aussehen. Missbrauch kann darin bestehen, Verhalten zu steuern, Daten zu extrahieren oder unbeabsichtigte Systemänderungen herbeizuführen — alles ohne eine klassische Sicherheitslücke auszunutzen.

Was ist die „tödliche Dreifaltigkeit“ in der Sicherheit von KI‑Agenten?

Die „tödliche Dreifaltigkeit“ beschreibt drei Bedingungen, die zusammen ein ernstes Sicherheitsrisiko für KI‑Agenten schaffen.

Die drei Bedingungen, die ernste Angriffe ermöglichen

- Erstens: Zugriff auf sensible Daten, etwa Dateien, Zugangsdaten oder interne Informationen.

- Zweitens: nicht vertrauenswürdige Eingaben, also Inhalte, die der Agent nicht vollständig verifizieren kann.

- Drittens: die Fähigkeit, externe Aktionen auszuführen, wie Anfragen zu senden, Systeme zu ändern oder Befehle auszuführen.

Einzeln sind diese Faktoren oft handhabbar. Gefährlich werden sie, wenn sie zusammenkommen. Ein Agent, der nicht vertrauenswürdige Eingaben liest und darauf handeln kann, bietet einen klaren Angriffsweg. Es ist entscheidend, zu kontrollieren, welche Aktionen einem Agenten erlaubt sind.

Sollten alltägliche Nutzer heute KI‑Agenten betreiben?

Für die meisten Menschen sind KI‑Agenten noch experimentelle Werkzeuge. In der richtigen Umgebung können sie nützlich sein — der Nachteil: Sie bringen neue Risiken mit sich, die nicht immer offensichtlich sind.

Wann der Einsatz eines KI‑Agenten Sinn machen kann

Ein KI‑Agent kann in kontrollierten und risikoarmen Szenarien sinnvoll sein. Dazu gehört das Experimentieren auf einem separaten Gerät. Manche Nutzer lassen Agenten nur nicht sensible Aufgaben übernehmen, etwa das Organisieren von Dateien oder das Testen von Abläufen.

Beispiel: Sie möchten, dass der Agent eine Reise‑Agenda erstellt. Er kann die nötigen Informationen nutzen, solange man ihm das Versenden von Nachrichten oder andere potenziell schädliche Rechte verwehrt.

Wenn Sie Einstellungen selbst sicher verwalten können und Fehler keine schwerwiegenden Folgen haben, ist ein Agent ein gutes Lernwerkzeug. Wichtig ist, den Umfang klein zu halten und den Zugriff streng zu begrenzen.

Wann KI‑Agenten keine gute Idee sind

KI‑Agenten sind ungeeignet, wenn sie Zugriff auf sensible Daten oder wichtige Konten haben. Das Betreiben von Agenten ohne klares Verständnis der Berechtigungen oder der Gefahren externer Eingaben erhöht das Risiko schnell.

Es ist ebenso legitim, darauf zu verzichten. Sich gegen den Einsatz eines KI‑Agenten zu entscheiden, ist eine vernünftige Wahl, wenn Bequemlichkeit zulasten von Sicherheit oder Seelenfrieden ginge.

Welche grundlegenden Schutzmaßnahmen sind beim Einsatz von KI‑Agenten unerlässlich?

Grundlegende Schutzmaßnahmen reduzieren Risiken und verhindern, dass Fehler zu ernsthaften Problemen werden.

Die Kaspersky‑Software kann eine zusätzliche Schutzschicht bieten, indem sie verdächtiges Verhalten meldet und Konten vor Übernahmen schützt. Unsere Pakete blockieren alles von Schadsoftware und Viren bis hin zu Ransomware und Spionage‑Apps.

Welche Sicherheitsmaßnahmen am wichtigsten sind

Isolation ist zentral. Führen Sie Agenten nach Möglichkeit auf separaten Geräten und Konten, damit sie keine wichtigen Daten oder Systeme beeinflussen. Beschränken Sie Berechtigungen auf das absolut Notwendige. Wir empfehlen, nicht standardmäßig vollständigen System‑ oder Kontozugriff zu gewähren.

Genehmigungsschritte sind ebenfalls wichtig. Die Verpflichtung zu einer Bestätigung vor sensiblen Aktionen schafft einen Schutzstopp, der unbeabsichtigtes Verhalten verhindern kann — etwa das eigenmächtige Ausgeben von Geld. Diese einfachen Kontrollen haben großen Effekt, ohne viel Komplexität hinzuzufügen.

Was bedeuten KI‑Agenten für die Zukunft der Verbraucher‑KI?

KI‑Agenten deuten auf eine Zukunft hin, in der KI‑Tools mehr tun als nur assistieren: Sie handeln. Dieser Wandel bringt Kompromisse mit sich, mit denen Verbraucher gerade erst umgehen lernen.

Was dieser Moment über den Reifegrad von KI‑Agenten aussagt

KI‑Agenten sind mächtig, aber noch unreif. Sie können Aufgaben automatisieren, haben jedoch noch Schwächen bei Urteilsvermögen und Sicherheit. Das heißt nicht, dass Agenten nicht sicherer oder zuverlässiger werden — aber die Erwartungen sollten realistisch bleiben.

Agenten zeigen, wohin die Entwicklung geht. Für einen breiten Alltagsgebrauch sind jedoch bessere Schutzmechanismen und von vornherein sicherheitsorientierte Designs nötig.

Weiterführende Artikel:

- Wie geht ChatGPT mit Cybersecurity‑Bedenken und potenziellen Risiken um?

- Welche Risiken birgt KI‑Cyberkriminalität in der heutigen digitalen Welt?

- Wie verbessern KI und maschinelles Lernen die Cyberabwehr?

- Welche Gefahren gehen heute von Deepfake‑Technologie aus?

Empfohlene Produkte:

FAQs

Ist OpenClaw kostenlos zum Herunterladen?

OpenClaw kann kostenlos von GitHub heruntergeladen werden. Es handelt sich um Open‑Source‑Software. Das bedeutet: Mehr Spielraum für Änderungen und Weiterverbreitung durch Dritte.

Lässt sich OpenClaw leicht einrichten?

Es gibt Tutorials, mit denen Einsteiger Bots schnell zum Laufen bringen. Eine anspruchsvolle, sichere Konfiguration benötigt jedoch Zeit und Fachwissen. Genau deshalb ist der Betrieb schlecht eingerichteter Software riskant.